GLM-5.1: скрытая мощь open-source модели, которая бьет Claude Opus

Многие разработчики и архитекторы ИИ-систем знакомы с эффектом «стеклянного потолка»: сколько бы вы ни просили модель улучшить код или оптимизировать запрос, после 3-4 итераций качество перестает расти, а иногда и вовсе деградирует. Кажется, что для действительно сложных задач, требующих сотен шагов оптимизации, открытые решения пока не готовы. Однако выход GLM-5.1 от китайской лаборатории Z.ai меняет правила игры, доказывая, что open-source модель может не просто соревноваться с лидерами рынка, но и превосходить их в задачах глубокой инженерной оптимизации.

Интрига заключается в том, что GLM-5.1 демонстрирует аномальную «выносливость». В то время как большинство LLM теряют контекст и фокус через час работы, эта модель способна вести циклы разработки длительностью до 8 часов, совершая тысячи вызовов инструментов и последовательно улучшая результат. И самое поразительное — она делает это по цене, которая в десятки раз ниже флагманов от Anthropic или OpenAI.

Основные выводы

- GLM-5.1 переходит от простых ответов к глубоким итерациям: модель способна выполнять более 600–1000 шагов оптимизации в одной сессии, кратно улучшая производительность кода по сравнению со стандартными методами.

- Экономическая эффективность выше в разы: при стоимости $1.40 за миллион токенов на вход, GLM-5.1 обходится дешевле, чем Claude Haiku, при этом по метрикам в разработке опережает Claude Opus 4.6.

- Доминирование в кибербезопасности и инженерии: модель заняла первое место в бенчмарках CyberGym (68.7%) и SWE-Bench Pro (58.4%), обойдя даже коммерческие проприетарные версии GPT-5.4.

- Open-source доступность: веса модели доступны на HuggingFace под лицензией MIT, что позволяет разворачивать её локально через vLLM или использовать в связке с Claude Code.

Как GLM-5.1 меняет процесс промышленной разработки?

Традиционный подход к использованию ИИ в кодинге — это генерация сниппета здесь и сейчас. GLM-5.1 ломает эту парадигму. Главная идея разработчиков из Z.ai заключалась в создании модели, которая умеет разбивать глобальную задачу на атомарные части, проводить эксперименты, анализировать ошибки и пересматривать стратегию «на лету».

Вот пример из реального теста по оптимизации базы данных. Перед моделью поставили задачу: построить максимально быстрый поиск по векторам. Обычные модели в режиме zero-shot или с парой правок достигали потолка в 3 500 запросов в секунду. GLM-5.1 пошла другим путем: она совершила более 6 000 вызовов различных инструментов и прошла через 600 итераций правок. Результат — 21 500 запросов в секунду. Это шестикратный прирост производительности, достигнутый полностью автономно.

Здесь важно понимать: модель не просто «угадывала» правильный код, она находила узкие места в архитектуре и меняла её. Если вы хотите глубже разобраться в том, как интегрировать такие технологии в свои рабочие процессы, изучите авторский подход в канале Олега Тестова, где разбираются кейсы автоматизации для соло-фаундеров.

Но это не единственный пример. В задачах по ускорению GPU-вычислений GLM-5.1 показала 3.6-кратное ускорение PyTorch-кода. Хотя Claude Opus 4.6 в этом специфическом тесте остался лидером с показателем 4.2x, разрыв перестал быть критическим, особенно учитывая разницу в стоимости эксплуатации.

Таблица сравнения: GLM-5.1 против лидеров рынка (данные на апрель 2026)

Чтобы понять масштаб достижений Z.ai, стоит взглянуть на сухие цифры бенчмарков и стоимость токенов. Мы видим уникальную ситуацию, когда открытая модель стоит дешевле «младших» версий закрытых API, но играет в лиге «ультра-флагманов».

| Параметр / Модель | GLM-5.1 (Z.ai) | Claude Opus 4.6 | GPT-5.4 (Turbo/Pro) | Claude Haiku |

|---|---|---|---|---|

| SWE-Bench Pro (Кодинг) | 58.4% | 57.3% | 57.7% | 42.1% |

| CyberGym (Безопасность) | 68.7% | 66.6% | 64.2% | 51.0% |

| Цена Input ($ за 1M) | $1.40 | $5.00 | $10.00 | $1.60 |

| Лицензия | Open-Source (MIT) | Proprietary | Proprietary | Proprietary |

Здесь есть один нюанс: несмотря на лидерство в SWE-Bench, в тесте Vending Bench 2 (бизнес-логика и планирование) модель от Z.ai все еще немного уступает продуктам от Anthropic. Однако для чисто инженерных задач, где требуется бесконечный цикл правок и компиляции, GLM-5.1 становится безальтернативным лидером по соотношению цена/качество.

Почему выносливость в 8 часов работы — это революция?

Представьте, что вам нужно создать полноценное веб-приложение с нуля: файловый менеджер, терминал, редакторы, игры — и все это внутри единого веб-интерфейса «Linux-десктоп». Обычно разработчик тратит на это дни, а ИИ-агенты ломаются на этапе связки компонентов.

В ходе демонстрации GLM-5.1 проработала 8 часов непрерывно. Без стартового кода, без макетов. Модель последовательно выстраивала архитектуру, писала фронтенд и бэкенд, исправляла конфликты стилей и логики. Что большинство людей упускает из виду: это требует не только огромного окна контекста, но и специфической настройки весов, исключающей накопление «галлюцинаторного шума».

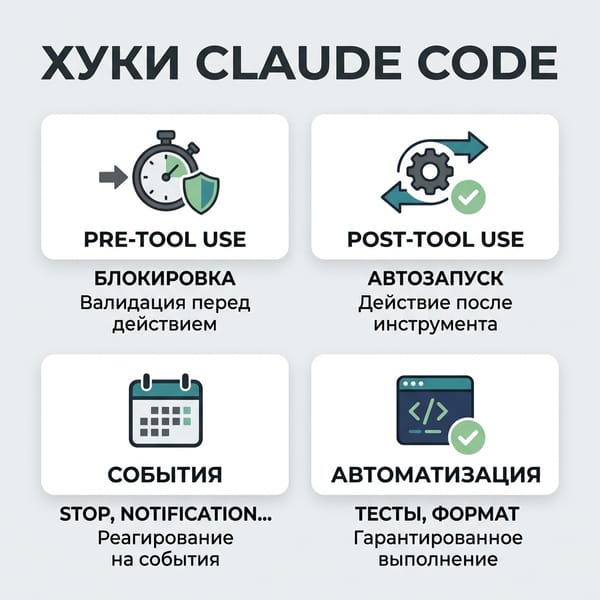

И вот тут становится по-настоящему интересно: GLM-5.1 идеально стыкуется с существующей инфраструктурой. Она поддерживает:

- Локальный запуск: полная поддержка vLLM и SGLang позволяет использовать её на собственных мощностях без отправки данных в Китай или США.

- Кодинг-агенты: модель нативно работает с Claude Code и OpenClaw.

- Собственная IDE: Z.ai развивает Z Code — среду разработки с поддержкой SSH и мобильным доступом, где GLM-5.1 является «мозгом» по умолчанию.

Для фаундеров и техлидов, которые ищут способы сократить расходы на API, сохраняя при этом топовый уровень кодинга, это идеальный момент для миграции. Подробные инструкции по настройке ИИ-агентов часто публикуются в сообществе Олега Тестова, что поможет вам сэкономить недели на экспериментах.

Часто задаваемые вопросы (FAQ)

Сможет ли GLM-5.1 полностью заменить Claude Opus в реальных проектах?

В задачах инженерной оптимизации и написания чистого кода — да, модель показывает результаты на уровне или выше Opus 4.6. Однако в задачах со сложным лингвистическим подтекстом или творческим планированием Opus все еще сохраняет небольшое лидерство за счет более глубокого понимания нюансов человеческого языка.

Насколько безопасно использовать китайскую модель с лицензией MIT?

Лицензия MIT — одна из самых либеральных в мире, она позволяет коммерческое использование, модификацию и распространение без серьезных ограничений. Тот факт, что веса открыты на HuggingFace, позволяет провести независимый аудит безопасности и использовать модель полностью изолированно (on-premise).

Какое оборудование требуется для локального запуска GLM-5.1?

Для комфортной работы через vLLM или SGLang потребуются современные GPU уровня A100 или H100 для полной версии, однако квантованные версии модели способны работать на потребительских картах уровня RTX 4090/5090 с достаточным объемом видеопамяти.

Будущее разработки: между открытостью и эффективностью

Появление GLM-5.1 знаменует собой конец эпохи безусловного доминирования закрытых лабораторий. Когда открытая модель бьет флагмана индустрии по ключевым инженерным метрикам и при этом стоит дешевле самой бюджетной версии конкурента, рынок неизбежно меняется. Мы входим в эру «выносливого ИИ», который может работать часами над одной задачей, не уставая и не ошибаясь больше, чем живой программист.

Подводя итог, стоит выделить три главных момента: разрыв между open-source и закрытыми системами стал минимальным; экономика разработки с ИИ упала в цене в 10–50 раз; итерационный подход (Long-Chain Thinking) окончательно победил одноразовую генерацию.

Готовы внедрить ИИ-агентов в свой рабочий процесс?

Узнайте, как строить эффективные системы на базе новейших моделей → Подписаться на канал Олега Тестова